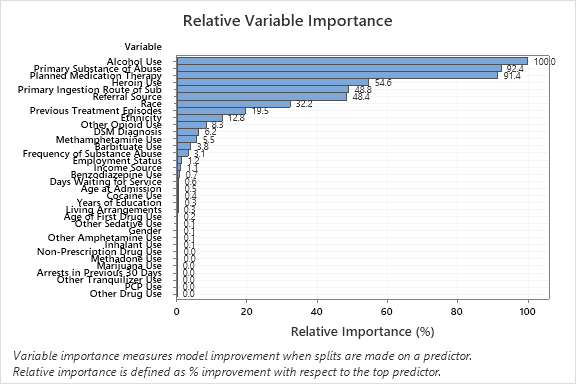

La importancia relativa de la variable estandariza los valores de importancia para facilitar la interpretación. La importancia relativa se define como la mejora porcentual con respecto al predictor más importante.

Una variable importante es una variable que se utiliza como divisor principal o sustituto en el árbol. La variable con la puntuación de mejora más alta se establece como la variable más importante, y las otras variables se clasifican en consecuencia. La importancia relativa de la variable estandariza los valores de importancia para facilitar la interpretación. La importancia relativa se define como la mejora porcentual con respecto al predictor más importante.

La importancia relativa se calcula dividiendo la puntuación de importancia de cada variable entre la mayor puntuación de importancia de las variables, y luego se multiplica por 100%.

Interpretación

- Sustancia primaria de abuso y Terapia de medicamentos planificada son aproximadamente 92% tan importantes como Consumo de alcohol.

- Uso de heroína es aproximadamente 55% tan importante como Consumo de alcohol.

- Ruta de Ingestión Primaria de Sub y Fuente de referencia son aproximadamente 48% tan importantes como Consumo de alcohol.

Aunque estos resultados incluyen 33 variables con importancia positiva, las clasificaciones relativas proporcionan información sobre cuántas variables controlar o supervisar para una determinada aplicación. Las caídas pronunciadas en los valores de importancia relativa de una variable a la siguiente variable pueden guiar las decisiones sobre qué variables controlar o supervisar. Por ejemplo, en estos datos, las tres variables más importantes tienen valores de importancia que son relativamente cercanos antes de una caída de casi 40% en importancia relativa para la siguiente variable. Del mismo modo, tres variables tienen valores de importancia similares cercanos a 50%. Puede quitar variables de diferentes grupos y rehacer el análisis para evaluar cómo afectan las variables de varios grupos a los valores de exactitud de predicción de la tabla de resumen del modelo.