Notation

.

.

Die Jacobi-Matrix von η ist eine (N X P)-Matrix mit Elementen, die gleich den partiellen Ableitungen der Modellfunktion in Bezug auf die Parameter sind:

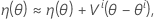

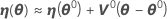

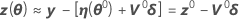

Dann ist eine lineare Approximation für η:

Sei θ* der Schätzwert der kleinsten Quadrate.

Gauß-Newton

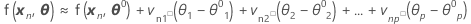

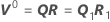

Einschließlich aller N Fälle

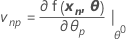

Dabei gilt Folgendes:

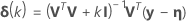

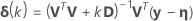

Minitab berechnet das Gauß-Inkrement δ0 zum Minimieren der ungefähren Summe der Quadrate der Residuen  unter Verwendung von:

unter Verwendung von:

.

.

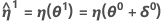

Der Punkt

sollte jetzt näher an y als η(θ0) sein, und Minitab verwendet den Wert θ1 = θ0 + δ0 zum Durchführen einer weiteren Iteration, indem neue Residuen z1 = y – η(θ1), eine neue Derivatmatrix V1 und ein neues Inkrement berechnet werden. Minitab wiederholt diesen Vorgang bis zur Konvergenz, die erreicht ist, wenn das Inkrement so klein ist, dass es keine sinnvolle Änderung der Elemente des Parametervektors gibt.

Manchmal führt das Gauß-Newton-Inkrement zu einer Zunahme bei der Summe der Quadrate. In diesem Fall ist die lineare Approximation dennoch eine nahe Approximation an die tatsächliche Oberfläche für einen hinreichend kleinen Bereich um η(θ0). Um die Summe der Quadrate zu verringern, bindet Minitab den Schrittfaktor λ ein und berechnet Folgendes:

- Bates und Watts (1988). Nonlinear Regression Analysis and Its Applications. John Wiley & Sons, Inc.

Levenberg-Marquardt

.1

.1

- Bates and Watts (1988). Nonlinear Regression Analysis and Its Applications. John Wiley & Sons, Inc.

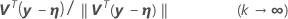

Relativer Versatz als Konvergenzkriterium

1. Bates und Watts (1988). Nonlinear Regression Analysis and Its Applications. John Wiley & Sons, Inc.