Hinweis

Dieser Befehl ist mit Predictive Analytics-Modul. Klicken Sie hier, um weitere Informationen zum Aktivieren des Moduls zu erhalten.

Hinweis

Minitab zeigt Ergebnisse sowohl für die Trainingsdaten als auch für die Validierungsergebnisse an. Die Validierungsergebnisse geben an, ob das Modell die Werte der Antwortvariablen für neue Beobachtungen angemessen prognostizieren oder die Beziehungen zwischen der Antwortvariablen und den Prädiktorvariablen adäquat zusammenfassen kann. Verwenden Sie die Trainingsergebnisse, um auszuwerten, ob das Modell übermäßig angepasst ist.

Prädiktoren gesamt

Die Anzahl der insgesamt verfügbaren Prädiktoren für das TreeNet-Modell®. Die Gesamtzahl ist die Summe der angegebenen stetigen und kategorialen Prädiktoren.

Wichtige Prädiktoren

Die Anzahl der wichtige Prädiktoren im TreeNet®-Modell. Wichtige Prädiktoren haben Wichtigkeitswerte, die größer als 0,0 sind. Mit dem Diagramm „Relative Variablenwichtigkeit“ können Sie die Rangfolge der relative Variablenwichtigkeit anzeigen. Wenn z. B. 10 von 20 Prädiktoren im Modell wichtig sind, werden die Variablen im Diagramm „Relative Variablenwichtigkeit“ in der Reihenfolge ihrer Wichtigkeit angezeigt.

Anzahl der gewachsenen Bäume

Standardmäßig baut Minitab 300 kleine CART®-Bäume auf, um das TreeNet®-Modell zu erzeugen. Dies ist ein guter Wert für eine anfängliche Untersuchung der Daten, aber möglicherweise empfiehlt es sich, mehr Bäume zu erzeugen, um ein endgültiges Modell zu erstellen. Wenn Sie die Anzahl der aufgebauten Bäume ändern möchten, öffnen Sie das Unterdialogfeld Optionen.

Optimale Anzahl von Bäumen

Die optimale Anzahl von Bäumen entspricht dem höchsten R2 oder der niedrigsten MAD.

Wenn die optimale Anzahl von Bäumen nahe der maximalen Anzahl von Bäumen liegt, die das Modell wächst, betrachten Sie eine Analyse mit mehr Bäumen. Wenn Sie also 300 Bäume aufbauen und die optimale Anzahl als 298 ermittelt wird, erstellen Sie das Modell mit einer größeren Anzahl von Bäumen neu. Liegt die optimale Anzahl weiterhin nahe der maximalen Anzahl, erhöhen Sie die Anzahl der Bäume weiter.

R-Quadrat

R2 ist der Prozentsatz der Streuung in der Antwortvariablen, den das Modell erklärt. Ausreißer haben eine größere Auswirkung auf das R2 als auf die MAD und den MAPE.

Wenn Sie eine Validierungsmethode verwenden, enthält die Tabelleeine R2-Statistik für den Trainingsdatensatz und eine R2-Statistik für die Validierungsmethode. Wenn die Validierungsmethode eine k-fache Kreuzvalidierung ist, verwendet die Validierung jede Faltung, wenn der Baumbau diese Faltung ausschließt. Die R2-Statistik aus den Validierungsergebnissen ist typischerweise ein besseres Maß dafür, wie das Modell für neue Daten funktioniert.

Interpretation

Verwenden Sie das R2, um zu bestimmen, wie gut das Modell für Ihre Daten passend ist. Je höher das R2, desto besser ist das Modell für Ihre Daten passend. R2 liegt immer zwischen 0 % und 100 %.

Eine Validierung von R2 , die wesentlich geringer ist als das Training R2 , zeigt, dass das Modell die Antwortwerte für neue Fälle möglicherweise nicht so gut vorhersagt und das Modell zum aktuellen Datensatz passt.

Wurzel des mittleren quadrierten Fehlers (RMSE)

Die Wurzel des mittleren quadrierten Fehlers (RMSE) ist ein Maß für die Genauigkeit des Modells. Ausreißer haben eine größere Auswirkung auf den RMSE als auf die MAD und den MAPE.

Wenn Sie eine Validierungsmethode verwenden, enthält die Tabelle eine RMSE-Statistik für den Trainingsdatensatz und eine RMSE-Statistik für die Validierungsergebnisse. Wenn die Validierungsmethode eine k-fache Kreuzvalidierung ist, verwendet die Validierung jede Faltung, wenn der Baumbau diese Faltung ausschließt. Die Validierungs-RMSE-Statistik ist typischerweise ein besseres Maß dafür, wie das Modell für neue Daten funktioniert.

Interpretation

Hiermit können Sie die Anpassungen verschiedener Modelle vergleichen. Kleinere Werte weisen auf eine bessere Anpassung hin. Ein Validierungs-RMSE, der wesentlich höher ist als das Trainings-RMSE, zeigt, dass das Modell die Antwortwerte für neue Fälle möglicherweise nicht so gut vorhersagt und das Modell zum aktuellen Datensatz passt.

Mittlerer quadrierter Fehler (MSE)

Der mittlere quadrierte Fehler (MSE) ist ein Maß für die Genauigkeit des Modells. Ausreißer haben eine größere Auswirkung auf den MSE als auf die MAD und den MAPE.

Wenn Sie eine Validierungsmethode verwenden, enthält die Tabelle eine MSE-Statistik für den Trainingsdatensatz und eine MSE-Statistik für die Validierungsergebnisse. Wenn die Validierungsmethode eine k-fache Kreuzvalidierung ist, verwendet die Validierung jede Faltung, wenn das Modell diese Faltung ausschließt. Die Validierungs-MSE-Statistik ist typischerweise ein besseres Maß dafür, wie das Modell für neue Daten funktioniert.

Interpretation

Hiermit können Sie die Anpassungen verschiedener Modelle vergleichen. Kleinere Werte weisen auf eine bessere Anpassung hin. Ein Validierungs-MSE, der wesentlich höher ist als das Trainings-MSE, zeigt, dass das Modell die Antwortwerte für neue Fälle möglicherweise nicht so gut vorhersagt und das Modell zum aktuellen Datensatz passt.

Mittlere absolute Abweichung (MAD)

Die mittlere absolute Abweichung (MAD) drückt die Genauigkeit in der gleichen Einheit wie die Daten aus. Auf diese Weise kann der Fehleranteil leichter erfasst werden. Ausreißer haben eine geringere Auswirkung auf den MAD als auf das R2, die RMSE und den MSE.

Wenn Sie eine Validierungsmethode verwenden, enthält die Tabelle eine MAD-Statistik für den Trainingsdatensatz und eine MAD-Statistik für die Validierungsergebnisse. Wenn die Validierungsmethode eine k-fache Kreuzvalidierung ist, verwendet die Validierung jede Faltung, wenn das Modell diese Faltung ausschließt. Die Validierungs-MAD-Statistik ist typischerweise ein besseres Maß dafür, wie das Modell für neue Daten funktioniert.

Interpretation

Hiermit können Sie die Anpassungen verschiedener Modelle vergleichen. Kleinere Werte weisen auf eine bessere Anpassung hin. Ein Validierungs-MAD, der wesentlich höher ist als das Trainings-MAD, zeigt, dass das Modell die Antwortwerte für neue Fälle möglicherweise nicht so gut vorhersagt und das Modell zum aktuellen Datensatz passt.

Mittlerer absoluter prozentualer Fehler (MAPE)

Der mittlere absolute Prozentfehler (MAPE) gibt die Genauigkeit als Prozentsatz des Fehlers an. Da es sich bei dem MAPE um einen Prozentsatz handelt, ist dieser Wert möglicherweise verständlicher als die anderen Genauigkeitsmaße. Wenn der MAPE beispielsweise durchschnittlich 0,05 beträgt, ist das durchschnittliche Verhältnis zwischen dem angepassten Fehler und dem tatsächlichen Wert für alle Fälle 5 %. Ausreißer haben eine geringere Auswirkung auf den MAPE als auf das R2, die RMSE und den MSE.

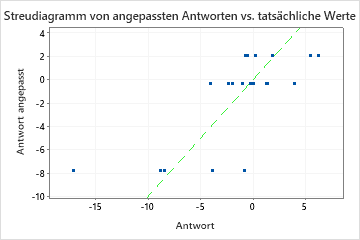

In einigen Fällen kann jedoch ein sehr großer MAPE auftreten, obwohl das Modell gut für die Daten passend zu sein scheint. Untersuchen Sie das angepasste vs. tatsächliche Antwortwertdiagramm, um zu sehen, ob irgendwelche Datenwerte nahe bei 0 liegen. Da beim MAPE der absolute Fehler durch die tatsächlichen Daten dividiert wird, können Werte, die nah bei 0 liegen, den MAPE stark ansteigen lassen.

Wenn Sie eine Validierungsmethode verwenden, enthält die Tabelle eine MAPE-Statistik für den Trainingsdatensatz und eine MAPE-Statistik für die Validierungsergebnisse. Wenn die Validierungsmethode eine k-fache Kreuzvalidierung ist, verwendet die Validierung jede Faltung, wenn das Modell diese Faltung ausschließt. Die Validierungs-MAPE-Statistik ist typischerweise ein besseres Maß dafür, wie das Modell für neue Daten funktioniert.

Interpretation

Hiermit können Sie die Anpassungen verschiedener Modelle vergleichen. Kleinere Werte weisen auf eine bessere Anpassung hin. Ein Validierungs-MAPE, der wesentlich höher ist als das Trainings-MAPE, zeigt, dass das Modell die Antwortwerte für neue Fälle möglicherweise nicht so gut vorhersagt und das Modell zum aktuellen Datensatz passt.