O que é análise de regressão?

Uma análise de regressão gera uma equação para descrever a relação estatística entre um ou mais preditores e a variável de resposta e para predizer novas observações. A regressão linear normalmente usa o método de estimativa de mínimos quadrados ordinários que deriva a equação minimizando a soma dos resíduos quadrados.

Por exemplo, você trabalha para uma empresa fabricante de batatas fritas que está analisando os fatores que afetam a porcentagem de batatas quebradas por embalagem antes da remessa (variável de resposta). Você está conduzindo a análise de regressão e inclui a porcentagem de batatas em relação a outros ingredientes e a temperatura de cozimento (Celsius) como seus dois preditores. A seguir encontra-se uma tabela dos resultados.

Análise de Regressão: Batatas Queb versus Porcentagem ; Temperatura

- Para cada 1 grau de aumento da temperatura de cozimento, o percentual de batatas quebradas deve aumentar em 0,022%.

- Para predizer o percentual de batatas quebradas para configurações de 0,5 (50%) de batatas e uma temperatura de cozimento de 175 °C, você calcula um valor esperado de 7,7% de batatas quebradas: 4,251 - 0,909 * 0,5 + 0,2231 * 175 = 7,70075.

- O sinal de cada coeficiente indica a direção da relação.

- Os coeficientes representam a mudança média na resposta para uma unidade de mudança no preditor mantendo constantes os outros preditores no modelo.

- O valor-p de cada coeficiente testa a hipótese nula de que o coeficiente é igual à zero (nenhum efeito). Portanto, os valores-p baixos indicam que o preditor é uma adição significativa ao seu modelo.

- A equação prediz novas observações com valores especificados dos preditores.

Observação

Modelos com um preditor são mencionados como regressão simples. Os modelos com mais de um preditor são conhecidos como regressão linear múltipla.

O que é regressão linear simples?

A regressão linear simples examina a relação linear entre duas variáveis contínuas: uma resposta (y) e um preditor (x). Quando as duas variáveis são relacionadas, é possível predizer um valor de resposta de um valor do preditor com exatidão melhor do que a chance.

- Examinar como a variável de resposta muda quando o preditor muda.

- Predizer o valor de uma variável de resposta (y) para qualquer variável preditora (x).

O que é regressão linear múltipla?

A regressão linear múltipla examina as relações lineares entre uma resposta contínua e dois ou mais preditores.

Se o número de preditores for grande, antes de ajustar um modelo de regressão com todos os preditores, você deve usar técnicas de seleção de modelo stepwise ou de melhores subconjuntos para remover preditores não associados às respostas.

O que é regressão de mínimos quadrados comum?

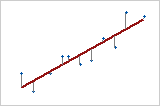

Na regressão por mínimos quadrados ordinários (OLS), a equação estimada é calculada determinando-se a equação que minimiza a soma do quadrado das distâncias entre os pontos de dados da amostra e os valores preditos pela equação.

Resposta vs. Preditor

Com um preditor (regressão linear simples), a soma dos quadrados das distâncias de cada ponto até a linha é a menor possível.

Pressuposições que deve ser atendidas para regressão OLS

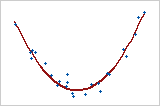

- O modelo de regressão e linear nos coeficientes. O método mínimos quadrados pode modelar curvatura transformando as variáveis (no lugar dos coeficientes). É necessário especificar a forma funcional correta para modelar qualquer curvatura.

Modelo Quadrático

Aqui, a variável preditora X é elevada ao quadrado para modelar a curvatura. Y = bo + b1X + b2X2

- Os resíduos têm uma média de zero. A inclusão de uma constante no modelo forçará a média a ser igual a zero.

- Todos os preditores são não correlacionados com os resíduos.

- Os resíduos não são correlacionados entre si (correlação serial).

- Os resíduos possuem variância constante.

- Nenhuma variável preditora é perfeitamente correlacionada (r=1) com uma variável preditora diferente. É melhor evitar correlações imperfeitamente altas (multicolinearidade) também.

- Os resíduos são normalmente distribuídos.

Como a regressão OLS fornecerá as melhores estimativas somente quando todas as suposições forem atendidas, é muito importante testá-las. Abordagens comuns incluem o exame de gráficos de resíduos, usando testes de ajuste e exibindo a correlação entre preditores usando o Fator de Inflação da Variância (VIF).