Sur ce thème

Coefficients

[1] P. McCullagh et J. A. Nelder (1989). Generalized Linear Models, 2nd Ed., Chapman & Hall/CRC, London.

Erreur type des coefficients

W est une matrice diagonale dans laquelle les éléments diagonaux sont fournis par la formule suivante :

où

La matrice de variance/covariance est fondée sur la matrice hessienne observée au lieu de la matrice d'informations de Fisher. Minitab utilise la matrice hessienne observée, car le modèle obtenu est plus fiable en cas d'erreur de spécification de la moyenne conditionnelle.

Si la liaison canonique est utilisée, la matrice hessienne observée et la matrice d'informations de Fisher sont identiques.

Notation

| Terme | Description |

|---|---|

| yi | valeur de la réponse pour la ie ligne |

| réponse moyenne estimée pour la ie ligne |

| V(·) | fonction de variance fournie dans le tableau ci-dessous |

| g(·) | fonction de liaison |

| V '(·) | première dérivée de la fonction de variance |

| g'(·) | première dérivée de la fonction de liaison |

| g''(·) | seconde dérivée de la fonction de liaison |

Pour plus d'informations, reportez-vous à [1] et à [2].

[1] A. Agresti (1990), Categorical Data Analysis, John Wiley & Sons, Inc.

[2] P. McCullagh et J.A. Nelder (1992), Generalized Linear Model, Chapman & Hall.

Z

La statistique Z sert à déterminer si le prédicteur est associé à la réponse de manière significative. De grandes valeurs absolues de Z indiquent une relation significative. La formule est la suivante :

Notation

| Terme | Description |

|---|---|

| Zi | Statistique de test pour une loi normale standard |

| Coefficient estimé |

| Erreur type du coefficient estimé |

Pour les petits échantillons, le test du rapport de vraisemblance peut être un test de signification plus fiable. Les valeurs de p du rapport de vraisemblance figurent dans le tableau des sommes des carrés d'écart. Lorsque l'effectif d'échantillon est assez important, les valeurs de p des statistiques Z sont proches des valeurs de p des statistiques du rapport de vraisemblance.

valeur de p (P)

Utilisée dans les tests d'hypothèse pour vous aider à décider de rejeter ou non une hypothèse nulle. La valeur de p est la probabilité d'obtenir une statistique de test au moins aussi extrême que la valeur réelle que vous avez calculée, si l'hypothèse nulle est vérifiée. Une valeur limite couramment utilisée pour la valeur de p est 0,05. Par exemple, si la valeur de p d'une statistique de test est inférieure à 0,05, rejetez l'hypothèse nulle.

Rapports des probabilités de succès pour la régression logistique binaire

Le rapport des probabilités de succès n'est fourni que si vous sélectionnez la fonction de liaison logit pour un modèle avec une réponse binaire. Dans ce cas, le rapport des probabilités de succès sert à interpréter la relation entre un prédicteur et une réponse.

Le rapport des probabilités de succès (τ) peut être tout nombre non négatif. Le rapport des probabilités de succès de 1 sert comme référence de comparaison. Si τ = 1, il n'existe aucune association entre la réponse et le prédicteur. Si τ < 1, les probabilités de succès de l'événement sont supérieures pour le niveau de référence du facteur (ou pour les niveaux inférieurs d'un prédicteur continu). Si τ > 1, les probabilités de succès de l'événement sont inférieures pour le seuil de référence du facteur (ou pour les niveaux inférieurs d'un prédicteur continu). Plus le rapport est éloigné de 1, plus le degré d'association est fort.

Remarque

Pour le modèle de régression logistique binaire avec une covariable ou un facteur, les probabilités de succès estimées sont calculées comme suit :

La relation exponentielle fournit une interprétation pour β : les probabilités de succès sont multipliées par eβ1 pour chaque augmentation d'une unité de x. Le rapport des probabilités de succès est équivalent à exp(β1).

Par exemple, si β est égal à 0,75, le rapport des probabilités de succès est de exp(0,75), soit 2,11. Cela indique une augmentation de 111 % des probabilités de succès pour chaque augmentation d'une unité dans x.

Notation

| Terme | Description |

|---|---|

| probabilité estimée de succès pour la ie ligne des données |

| coefficient estimé de l'ordonnée à l'origine |

| coefficient estimé pour le prédicteur x |

| point de donnée pour la ie ligne |

Intervalle de confiance

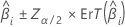

L'intervalle de confiance du grand échantillon pour un coefficient estimé est le suivant :

Concernant la régression logistique binaire, Minitab fournit des intervalles de confiance pour les rapports des probabilités de succès. Pour obtenir l'intervalle de confiance des rapports des probabilités de succès, utilisez un exposant pour les limites supérieure et inférieure de l'intervalle de confiance. L'intervalle indique l'étendue des probabilités de succès pour chaque variation d'unité du prédicteur.

Notation

| Terme | Description |

|---|---|

| ie coefficient |

| probabilité cumulée inverse de la loi normale standard à  |

| seuil de signification |

| erreur type du coefficient estimé |

Matrice de variance/covariance

Matrice d x d, où d représente le nombre de prédicteurs plus un. La variance de chaque coefficient figure dans la cellule diagonale et la covariance de chaque paire de coefficients figure dans la cellule hors diagonale appropriée. La variance est l'erreur type du coefficient au carré.

La matrice de variance/covariance provient de la dernière itération de la valeur inverse de la matrice d'informations. La matrice de variance/covariance a la forme suivante :

W est une matrice diagonale dans laquelle les éléments diagonaux sont fournis par la formule suivante :

où

La matrice de variance/covariance est fondée sur la matrice hessienne observée au lieu de la matrice d'informations de Fisher. Minitab utilise la matrice hessienne observée, car le modèle obtenu est plus fiable en cas d'erreur de spécification de la moyenne conditionnelle.

Si la liaison canonique est utilisée, la matrice hessienne observée et la matrice d'informations de Fisher sont identiques.

Notation

| Terme | Description |

|---|---|

| yi | valeur de la réponse pour la ie ligne |

| réponse moyenne estimée pour la ie ligne |

| V(·) | fonction de variance fournie dans le tableau ci-dessous |

| g(·) | fonction de liaison |

| V '(·) | première dérivée de la fonction de variance |

| g'(·) | première dérivée de la fonction de liaison |

| g''(·) | seconde dérivée de la fonction de liaison |

Pour plus d'informations, reportez-vous à [1] et à [2].

[1] A. Agresti (1990), Categorical Data Analysis, John Wiley & Sons, Inc.

[2] P. McCullagh et J.A. Nelder (1992), Generalized Linear Model, Chapman & Hall.